人机交互是智能座舱实现人与车、人与生态联通的重要纽带。智能座舱相对于传统座舱实现了多模态交互的创新,本文从触控、语音、手势、眼控、生物特征与生物电交互、多屏交互联通等维度对智能座舱新型交互进行了系统总结,并探讨了智能座舱人机交互技术发展面临的挑战。

01

智能座舱人机交互发展

随着新能源汽车产业蓬勃发展,智能座舱软硬件产业链迎来需求爆发期。数据显示,目前国内座舱智能配置水平的渗透率约为48.8%,到2025年中国智能座舱新车市场渗透率预计将超过75%,到2030年市场规模将超过1600亿元。智能座舱是指配备传感器、控制器、显示终端、通讯终端、环境终端等设备,并运用云服务、网络传输、操作系统、芯片等基础技术,实现人车智能交互,具备信息娱乐、人机交互、安全提醒、网联服务、万物互联、舒适性智能体验等功能,打造“安全、舒适、便捷、个性”的智慧空间。其核心内涵是通过支撑功能实现的硬件终端及技术,具备以人的感知为核心的智能化功能(非智能驾驶功能),实现“自学习、自进化、自成长”的软硬兼备的智能化终端。

其中人机交互是实现人与车、人与生态联通的重要纽带。纵观汽车产业的发展历史与汽车产品的演化历程,可以看到,智能座舱人机交互的发展主要经历以下阶段,分别为 2000年以前机械时代,其主要由机械式仪表盘、简单的音频播放设备和单屏触屏构成,物理按键功能单一,集成度较低,无智能化。2002年后进入电子时代,此时期仍多为物理按键,极少数为触屏,且集成度较低,智能化程度较低。2020年至今智能时代,智能座舱正朝着以驾乘需求、用户情感为中心,以场景为驱动,满足驾乘人员不同需求的方向发展。其主要由更为丰富的大型全液晶仪表盘、全面触控的中控设备、先进的车载信息娱乐系统、便利的生物识别系统等为驾驶员及乘客在座舱内营造出全新的用户体验。未来将进一步走向多模感知,主动决策、人性交互,给乘客带来个性化、高情商、便捷化体验。人机交互的发展从复杂走向简单,从抽象操作走向自然交互,从被动响应走向主动交互,将在场景化、人性化、个性化三个层面飞速发展。

02

智能座舱新型人机交互技术

ErgoLAB智能座舱触控交互技术,包括手指交互、鼠标交互、键盘交互,可采集手指或鼠标的点触数据,实现界面实时结果反馈及触控交互的可视化分析,提高驾驶便捷性和安全性。如:

提高信息获取效率:驾驶员在驾驶过程中可快速访问和显示车辆状态、导航信息、来电提醒等,提高驾驶员获取关键信息的效率。

智能座舱语音交互技术

车载语音交互逐步走出单纯“控制方式”的狭隘理解,走向更丰富的使用场景。它通过使用自然语言处理(NLP)、语音识别(ASR)、语音合成(TTS)等技术,允许驾驶员和乘客通过语音与车辆系统进行交流和控制。凭借来自汽车和驾驶员的语境化和情境化数据,所提供的汽车助手能够主动推荐导航路线、兴趣内容。随着大模型的进一步发展,系统能够以更加直观智能的方式对语音指令进行聆听、理解并做出回应,最终实现对驾驶员干扰的最小化。

ErgoLAB智能座舱语音交互测试平台,支持在线与离线语音交互,通过采集语音数据,可实现语音识别、语音转写、语义分析并准确执行命令等功能,可覆盖导航、音乐播放器、车辆控制等多种场景,为智能座舱语音交互设计提供测试平台,及语音交互设计优化提供数据支撑。如:

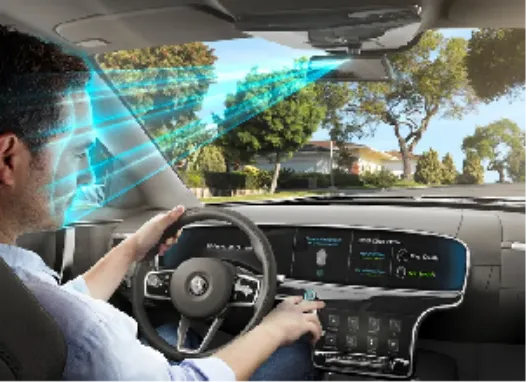

智能座舱手势交互技术

智能座舱手势识别技术通过数学算法识别人类手势,用户可以使用简单的手势来控制或与设备交互,通过手势发出指令操控汽车。其中,二维手势为简单手势识别,可以智能识别出几个静态的手势动作,如握拳或五指张开等。三维手势识别增加了Z轴的信息,可识别各种手型、手势和动作。

ErgoLAB智能座舱手势交互测试平台支持高自由度手势交互,可自动计算手部关节点,精确识别手势动作,实现单手操控与双手协同交互,为智能座舱触控及手势交互测评提供了测试平台,以便优化手势交互形态,降低对驾驶干扰。如:

减少交互负荷:智能座舱眼控交互通过简化交互循环周期,提高交互效率,实现无摩擦交互

在高过载环境下,飞行员肢体活动困难,追踪目标时眼球移动先于头部移动,利用眼睛注视方向瞄准比用头部位置瞄准能更快地锁定目标并发起攻击

生物特征与生物电交互

基于脑电信号可实现人脑与计算机或其他电子设备的通讯和控制。对大脑皮层的脑电信号进行收集,然后对该信号进行处理和特征提取,通过信号控制及信息反馈机制来完成脑机信息交互。即将脑电信号由设备转换为控制信号从而实现相应功能,最后给予大脑反馈信息。可以用于军事训练、运动想象控制、以及人员的状态识别等。

肌电控制是基于表面肌电信号,通过电极记录下来的神经肌肉活动。通过表面肌电信号可以控制机械设备:如小汽车或机器人,利用不同范围或不同肌肉群的肌电信号控制车或机器人的前进、倒退、左右转弯等,使得人的意识与机械设备统一,实现人机一体化。

ErgoLAB智能座舱一方面可提供智能座舱生物特征及生物电采集与监测设备和环境,另一方面还支持结合AI算法,辅助进行面部表情分析、驾驶分心、疲劳、应激等状态识别,快速搭建实验平台。

多屏交互联通

车载界面设计正朝着提供更强烈视觉冲击和个性化体验的方向发展。未来智能座舱将采用多屏联动技术,屏幕布局和数量将更加灵活,可交互屏幕遍布中控台、扶手台、后排、车门和车窗,满足乘客的个性化需求。屏幕内容可以方便地在不同设备间共享和转移,同时,通过区块分区设计,重要信息将更易于获取,减少驾驶员注意力分散。曲面屏幕技术的应用进一步提升了操作体验和屏幕的耐用性。车辆还能通过感知技术识别车主并在车窗上显示个性化信息,如问候、续航、行程等。车窗内壁屏幕支持互动功能,包括触控、影像捕捉和传输,甚至具备绘图和导航定位能力。通过Wi-Fi连接,车窗屏幕能与手持设备进行屏幕镜像映射。信息娱乐系统为车内乘客提供后座娱乐功能,支持多显示和多内容服务。

此外,智能座舱将集成更多功能,如通过ECU集成手势和语音识别、ADAS功能,并通过MCU与ECU通信获取车辆关键信息,实现直观的人机交互。大数据分析和AI技术将使信息反馈更实时高效。AI技术还能根据用户喜好自动配置驾驶舱,智能算法学习并优先处理内容,HUD结合AR技术则进一步提升了驾驶的便捷性和安全性。

ErgoLAB智能座舱可结合柔性座舱及虚拟仿真环境,实现多屏人机交互设计与测评,降本增效,以人为本,快速推进智能座舱多屏交互设计智能、友好、人性、个性发展。

03

人机交互技术发展挑战

智能座舱的快速发展得益于政府政策支持、技术进步及市场接受度提高。政府出台了《车联网产业发展行动计划》等政策,推动智能汽车产业的高质量发展。技术上,人工智能、大数据、物联网、5G通信等为智能座舱提供了坚实的技术基础,同时,车载传感器和芯片的发展也加速了智能座舱的创新。市场上,用户对大屏操作的习惯逐渐取代了对传统按钮的依赖,为智能座舱的大屏化和多屏化创造了有利条件。尽管智能座舱人机交互不断创新,但整体仍处于早期发展阶段,面临许多挑战。

驾驶安全的挑战

智能座舱设计在提升用户体验的同时,也对驾驶安全带来挑战。大屏取代实体按钮减少了盲操作,但驾驶员查看屏幕信息时,如低头1~3秒,相当于60km/h车速下闭眼行驶17米,因此屏幕内容的清晰度、交互的简洁性、设备的响应速度都会影响行车安全。尽管丰富的车内应用增加了娱乐和生活便利性,但信息过载可能分散驾驶员注意力,影响对紧急情况的响应。

驾驶任务的多样性,如自然环境、车况、路况等多变参数,构成复杂的驾驶场景,系统若缺乏对某些场景的预判,可能威胁安全。

智能座舱采取多种措施保障驾驶安全:使用HUD减少分心,通过语音、震动、手势等多模态交互降低操作干扰,提升车机芯片和算力以加快系统响应,并通过辅助驾驶系统和大数据学习预防未知场景的风险。同时,限制驾驶时的某些行为也是确保安全的重要手段。

智能驾驶的挑战

智能驾驶的L0至L5级别反映了不同的技术需求和用户互动设计。目前,大多数车辆的智能驾驶功能处于L2至L3级别,能够执行车道保持和自适应巡航等任务,减轻驾驶员的负担。然而,由于智能驾驶技术的不完善和行为不可预测,导致用户信任度不高,使用率低,并可能引发紧张和焦虑。在设计智能驾驶体验时,需要优先考虑用户的安全感,通过增强驾驶员的控制感来满足安全需求。

对于L2至L3级别的智能驾驶,驾驶员必须持续监控周围环境,并准备随时接管车辆,这对驾驶员的反应时间和接管过程的平滑性提出了挑战。系统应在需要驾驶员接管前给出明确提示,并提供足够的反应时间,确保接管操作自然且准确。现有的智能驾驶功能存在一些用户体验问题,包括高学习成本、复杂的预警和制动机制、繁多的辅助驾驶图标以及缺乏优先级的声音提示,这些都增加了驾驶员的认知负荷。在长时间使用L2级以上的智能驾驶功能时,用户可能会变得困倦,放松警惕,甚至过度依赖系统,对突发事件反应不足。智能驾驶技术在提升驾驶体验和安全性的同时,也带来了新的挑战。随着智能驾驶级别的提高,智能座舱的设计挑战将转向如何创造更优质的出行体验。

信息安全的挑战

随着汽车智能化和网联化的发展,车辆的定位、导航、远程控制和诊断功能越来越普及,用户出行数据和驾驶员信息等都可云端存储,带来便利的同时,也引发隐私和安全风险。车机系统若遭黑客攻击,可能导致数据泄露或影响行车安全。智能座舱HMI面临的挑战包括保护车内乘员隐私,尤其是在多人共用车辆时。

一些车型采用车内摄像头识别驾驶员身份,实现账号自动切换和信息隔离,保护个人隐私。车主可设置应用权限,隐藏敏感信息,如通讯录、导航记录等。此外,借车人可在离开时退出账号,删除个人信息,保障隐私不被车主查看。

在多人同乘情况下,为避免尴尬,一些车型提供主驾隐私模式,隐藏个人敏感信息,来电通知仅在仪表屏显示。智能座舱HMI在追求大屏化、多屏联动和网联化的同时,如何有效保护每位用户的隐私,仍是一大挑战。

人因工程的挑战

人因工程以人为本,着眼于提高人的工作绩效,防止人的失误,在尽可能使系统中人员安全、舒适的条件下,统一考虑人一机器一环境系统总体性能的优化。智能座舱的人机交互设计必须考虑人因工程,即研究人在工作环境中的解剖学、生理学和心理学等方面的各种因素,研究人和机器及环境的相互作用,研究在工作中、生活中和休息时怎样统一考虑工作效率、人的健康、安全和舒适等问题的学科。所以,设计时首先要基于人体尺寸和人眼特征合理布局车内操作空间和视线范围,以提升交互体验。其次,需考虑驾驶员的心理状态,如分心、疲劳等,结合DMS系统设计安全产品。多重资源理论、耶德-道德森定律和SRK模型指导我们理解不同任务对注意力的不同要求,以及新手与老司机在驾驶任务上的差异。

设计师应确保空间尺寸适应人体工程学,多模态交互合理配置,避免互相干扰,同时平衡驾驶任务难度,既不会过度分散注意力,也不会过于简单导致警惕放松,同时兼顾新手和老司机的需求。

04

小结

智能座舱人机交互虽面临多重挑战,但随着技术的不断进步和精准的测评,其发展前景广阔。人机交互产品迅速发展,功能日益丰富,但也伴随着伪需求问题。ErgoLAB智能座舱通过结合生理信号采集、眼动追踪、驾驶员监控系统(DMS)、健康监测等技术,支持多感官交互系统搭建,采集多维度数据。利用AI算法和人机环境同步平台,实现多模态信息处理、特征提取,并自动生成评估报告,旨在提升智能座舱的交互效率和安全性,优化产品设计。