AI领域永远都在革新。但随着大模型对算力需求的高速增长,现阶段生产的芯片很难满足业界需求。

前阵子,英特尔发布了第五代英特尔至强可扩展处理器,这款产品不仅在性能指标上有很大提升,在AI性能上也非常强劲。甚至可以说,能够胜任部分AI大模型的推理工作。

不过,口说无凭,唯有跑分才能证明真正的实力。近日,MLCommons公布了针对AI推理的MLPerf v4.0基准测试结果。

比第四代强1.42倍

第五代至强内置了英特尔®高级矩阵扩展(英特尔® AMX)的第五代英特尔®至强®可扩展处理器(以下简称“第五代至强”)在测试中表现优异,进一步彰显了英特尔致力于通过丰富且具有竞争力的解决方案推动 “AI无处不在”的承诺。截至目前,英特尔仍是唯一一家提交MLPerf测试结果的CPU厂商。与第四代至强在MLPerf推理v3.1基准测试中的结果相比,第五代至强的测试结果平均提升1.42倍。

英特尔公司副总裁兼数据中心与人工智能事业部产品管理总经理Zane Ball表示:“我们将持续提升CPU和加速器等广泛产品组合在行业基准测试中的AI性能。此次全新的MLCommons结果显示,我们提供的AI解决方案能够满足客户不断变化、多样化的AI需求。同时,至强处理器也为客户提供了可快速实现AI部署,且极具性价比的选择。”

英特尔产品迄今为止在多轮MLPerf基准测试中均所展示出领先的训练及推理性能,该测试结果亦为客户树立了可用于评估产品AI性能的行业标准。

关于第五代至强的测试结果:

与第四代至强在MLPerf推理v3.1性能基准测试中的表现相比,经由硬件及软件优化的第五代至强性能平均提升1.42倍。其中,针对具备连续批处理(continuous batching)等软件优化的GPT-J模型,与v3.1的测试结果相比,第五代至强的性能提升约1.8倍;同样,得益于MergedEmbeddingBag以及基于英特尔AMX的其他优化,DLRMv2的测试结果显示出约1.8倍的性能提升和99.9的准确率。

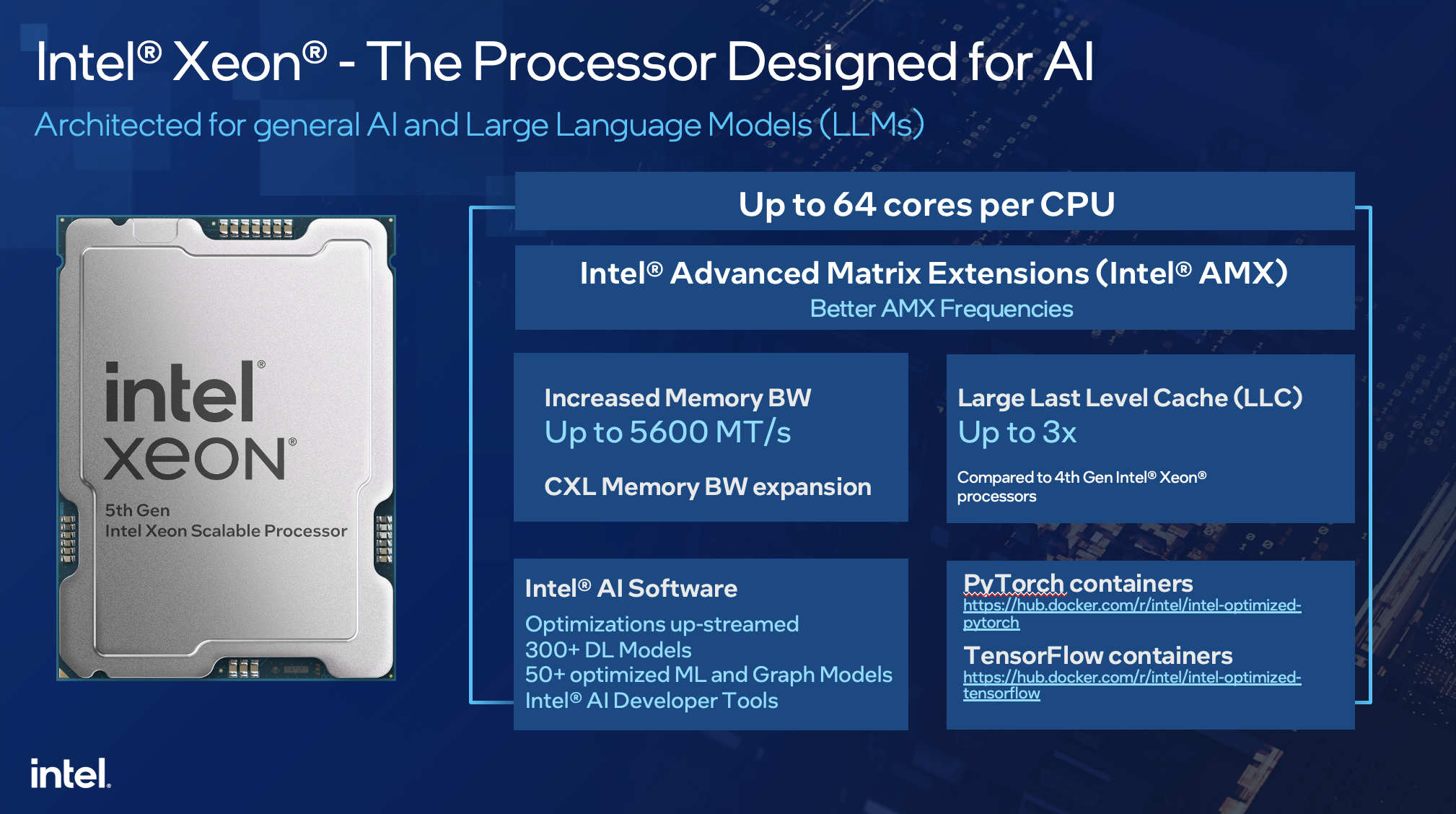

第五代英特尔®至强®可扩展处理器

与此同时,英特尔非常自豪地与包括思科、戴尔、广达、Supermicro和纬颖科技在内的广大OEM伙伴们展开合作,助力其提交基于自身产品的MLPerf测试结果。英特尔不仅于2020年开始提交基于第四代至强的测试结果,同时至强可扩展处理器亦是参与MLPerf测试的产品中,众多加速器的主机CPU。

此外,第五代至强可在英特尔®开发者云平台上进行评估。该环境中,用户可以进行小型及大规模AI训练(譬如大语言模型或生成式AI)、运行大规模的推理工作负载,以及管理AI计算资源等。

跑大模型,也可以用CPU

面对大模型这一新风口,全球科技公司均将目光投向了AI芯片,特别是GPU。但GPU的产量与HBM,或者说2.5D封装能力直接挂钩。这让本就供应吃紧的GPU再遇瓶颈,导致供需严重失衡。

与之相悖的是,眼下AI大模型“拼杀”的关键在于做大参数量,用“力大砖飞”实现更为强大的智能涌现。可以说,即便是面对AI芯片涨价,多少公司也会选择购买,毕竟错过这个风口,或许就会失去竞争力。

对于大型数据中心来说,每颗芯片都在牟足力气,全功率地运行着,如果能拥有更多AI性能,那么,还需要额外购置一批GPU吗?

事实上,我们都陷入了一种思维定势,其实跑AI并非只有GPU一个选择,CPU也已经具备很强大了AI性能。

亚信科技就在自家OCR-AIRPA方案中采用了CPU作为硬件平台,实现从FP32到INT8/BF16的量化,从而在可接受的精度损失下,增加吞吐量并加速推理。将人工成本降至原来的五分之一到九分之一,效率还提升5~10倍。

被改变的,不只是互联网和通信领域,AI制药被看作是终结药物研发“双十定律”的希望,在这个领域中AlphaFold2 这类大型模型被视为最重要的算法。去年开始,至强可扩展平台就开始使AlphaFold2端到端的通量提升到了原来的23.11倍,而第四代可扩展处理器让这个数值再次提升3.02倍。

可以说,将CPU用于AI推理正在不断证实可行。而现在,第五代至强可扩展处理器能够在无需添加独立加速器的前提下,运行高达200亿参数的模型推理,且延迟低于100毫秒。一款为AI加速而生,且表现更强的处理器诞生了。

CPU,怎么让AI跑起来

很多人会奇怪,为什么第五代至强作为一个通用处理器,能够运行AI负载?事实上,除了本身落在第五代至强的AI负载,其中内置的一系列的加速器是关键。

这种设计可以与时下MCU(单片机)的流行做法进行对比,通过内置DSP、NPU,分走一部分部分AI负载,让AI任务跑得更高效,从而更省电,至强也是类似的原理。

这种设计在早期的至强可扩展处理器中就出现过,只不过,那时候大家没有过多关注,也没有那么AI任务需要跑。

具体看第五代至强,其内置的英特尔AVX-512及英特尔® AMX(英特尔®高级矩阵扩展)功能是关键,这两个加速器在第四代至强中就已搭载,而在第五代至强中,AMX支持新的FP16指令,同时混合AI工作负载性能提高2~3倍。

加之第五代至强本身性能的提升,使其本身性能就能更从容应对AI负载:CPU核心数量增加到64个,单核性能更高,每个内核都具备AI加速功能;采用全新I/O技术(CXL、PCIe5),UPI速度提升。

根据行业人士分析,CPU做大模型推理,最大的难点不在计算能力,而在内存带宽。第五代至强的内存带宽从4800 MT/s提高至5600 MT/s,三级缓存容量提升至近3倍之多,同时插槽可扩展性,支持从一个插槽扩展至八个插槽,这些都为第五代至强支持大模型提供了坚实的后盾。

从数据上来看,与上一代产品相比,第五代至强相同热设计功耗下平均性能提升21%;与第三代产品比,平均性能提升87%。相较于前一代产品,第五代至强不仅迭代了性能,还带来了42%的AI推理性能提升。

此外,在一系列加速器中,英特尔®可信域拓展(英特尔® TDX)提供虚拟机(VM)层面的隔离和保密性,从而增强隐私性和对数据的管理。

不止如此,第五代至强还是迄今为止推出的最“绿色”的至强处理器,它能够帮助用户管理能耗,降低碳足迹。可以说,软件只是一方面,归功于第五代至强内的多种创新技术和功能,搭配干活,效率更高,最终体现出来的就是更低的功耗。

CPU未来发展趋势,一定是拼功耗,这需要全方位发力。首先是工艺,随着工艺逐渐提升到Intel 3、Intel 20A、Intel 18A,功耗会越来越低,每一代都会有两位数的功耗降低。封装也一样,使用先进的封装技术把不同制程的芯片通过Chiplet架构放在一起,进行一个运算,并不需要把所有地方都用起来,而是只使用对应的区域,这样功耗自然就降低了。还有,就是针对不同的工作负载做优化。

有时候调整应用程序的架构也可以最大限度地降低功耗。举例来说,如果要训练大模型,假设总共有20个大模型,每个模型的训练周期为3个月,需要1000台机器来训练,每台机器功率为1万瓦。如果规定只需训练其中的5个模型,而剩下的15个模型不需要训练,这样就能节省75%的电能。因此,有时候通过调整应用程序的架构,可以更有效地降低功耗。

“随着算力的持续高速发展,如何实现数据中心的节能减碳,改变‘电老虎’的形象,对寻求采用可再生能源和更环保的技术方面有了更高的需求。”英特尔数据中心与人工智能集团副总裁兼中国区总经理陈葆立对AI大模型时代提出了这样的担忧,第五代至强就是节能减碳的关键。

与此同时,英特尔也有一系列的产品和技术创新,如通过更高效的冷却技术、智能能源管理系统等推动新型和存量数据中心进行节能减排,并携手中国合作伙伴推动应用落地。