今天,你的朋友圈可能被一个词刷屏了——GPT-4。

这是OpenAI刚刚发布的新一代多模态预训练大模型,它的上一代产品GPT-3就是此前爆火的、堪称“无所不知、无所不能”的“聊天机器人”ChatGPT的基础模型。

如今GPT-4的发布,也让ChatGPT迎来了一次大更新:ChatGPT不仅支持文字输入,还能看得懂图片、甚至是漫画、梗图,让吃瓜群众直呼:太太太太强了!

而在汽车领域,功能强大的GPT-4也为我们带来了更多联想:以GPT-4为代表的多模态大模型,能否应用在自动驾驶技术?是否会成为自动驾驶的下一个颠覆性技术?

下面,我们好好聊聊。

什么是“多模态大模型”?

实际上,这个词应该拆开来看:“多模态”和“大模型”。

“多模态”比较好理解,简单来说,就是指模型可以处理多种结构/类型的数据,例如GPT-4,它既可以处理你输入的文本,也可以处理你上传的图片。

而“大模型”,其实目前还没有一个明确的定义,一般来讲它是指“Foundation Model”,又译作“基础模型”,它最大的特点就是“大规模”。

“大模型”往往包含了上亿的参数量,例如前面提到的GPT,从GPT-1到GPT-3,模型的参数量从1.1亿个增长到了1750亿个,几年的时间内增长了一千多倍。

这是因为,在Transformer网络提出后,研究人员惊讶地发现,模型参数量的不断提升,会让模型的能力持续提高。于是,人民便开始在模型中加入越来越多的参数,导致模型规模屡创新高。

同时,“大模型”还有另一个特点——“无监督预训练”。

大模型参数量大、结构大,还需要大量的数据集进行训练,而对如此庞大的数据进行人工标注显然是困难的。因此,针对大模型的特性,往往会采用“无监督预训练”(亦称“自监督学习”)模式,可以让模型在海量数据中自行学习,无需人类干预,这让模型可以快速地在训练中成长,提高了训练效率。

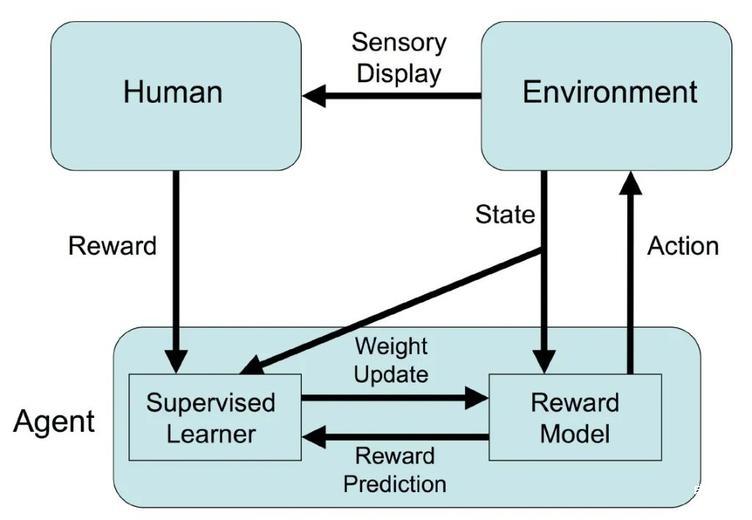

而在预训练后,还会对大模型进行RLHF(人类反馈强化学习),在这个阶段则引入了大量的人工,通过数据标注等方式帮助模型进化,进一步提升模型的推理能力。

因此,多模态大模型其实可以通俗理解成一种“可以处理多种类型数据的包含大量参数的AI模型”,而它的最大优势就在于推理能力强,准确率高,可以完成复杂的任务(例如帮你写一段代码、解读搞笑图片等等)。

多模态大模型与自动驾驶

现在回到最初的问题:多模态大模型对自动驾驶有帮助吗?

答案是肯定的。

其实,在自动驾驶领域,“多模态”早已得到应用,这是因为自动驾驶任务本就是适合多模态场景的。

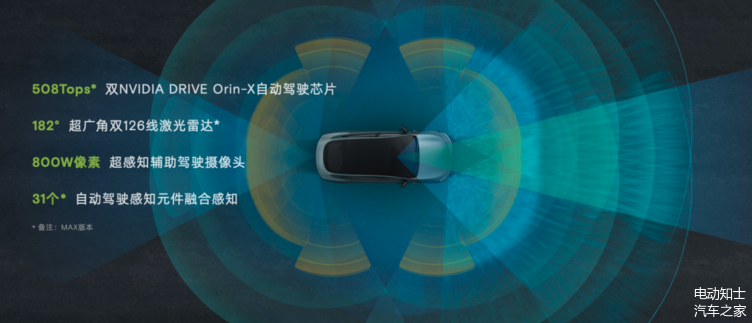

例如环境感知,现在的感知系统往往包含多种数据结构,例如视觉信号、雷达信号、地图数据等等。而不同的数据类型间存在不同的特性,例如视觉信号数据量大,但受光线影响大;雷达信号数据量小,但受光线影响小。

如果针对不同数据使用单模态感知,则有可能出现推理结果的冲突和错误,影响系统稳定性,因此,基于多模态的融合感知技术成为了许多自动驾驶厂商的研发核心。

而如果基于多模态大模型,甚至可以让自动驾驶技术更上一层。

从结构上讲,多模态大模型中含有处理多种类型数据的AI网络,这种网络可以称之为“专家网络”。

想要处理什么数据,就要在大模型中置入这种数据的专家网络,甚至可以针对某一模态数据的不同方面特征而配备多个相同模态的专家网络。

在实际推理时,各个专家网络根据输入的数据给出相对应的结果,再通过算法或者融合模型对结果进行融合分析,从而实现多模态数据的处理。

也就是说,如果存在一个自动驾驶多模态大模型,只要向大模型输入视觉信号、雷达信号、地图数据、定位信息等,即可直接推理出行驶路线。

如果把这个概念继续引申,将自动驾驶大模型扩展为车载多模态大模型,则还可以接入文字和语音数据,让AI不仅可以负责自动驾驶,还能同时担负起智能座舱的交互任务,让AI司机和AI管家合二为一。

可惜的是,以上皆为构想。因为多模态大模型要想应用在车载自动驾驶技术上,仍然面临许多困难。

首先是延迟问题。

由于多模态大模型的规模十分庞大,这就导致了它的推理耗时的增加。例如与ChatGPT对话,往往需要等待数秒才能得到完整的回答。

这种“等待”对于ChatGPT这类AIGC(AI创作)来说并不敏感,但对于自动驾驶这种场景来说则极为关键。要知道,在汽车高速行驶时,每秒都会行驶出几十米,很多交通事故往往是瞬间发生的,多模态大模型难以应对这种场景。

其次是部署问题。

由于自动驾驶的车载特性,任何关键功能都要求本地化脱网运行。而多模态大模型由于规模庞大,内含数以亿计的参数量,则很难实现本地化部署。

同时,大模型工作的算力需求,相比传统模型也是呈指数级上升的,例如2019年谷歌发表的T5模型,参数量110亿,如果以单张英伟达V100训练,则理论上训练一次需要66年。

当然了,虽然高延迟、难部署,让多模态大模型距离自动驾驶还有相当的距离,但这也不代表它对现有自动驾驶技术没有帮助。

例如前段时间推出的百度文心大模型和毫末智行DriveGPT,虽然都无法直接部署在车端,但百度文心大模型可以帮助自动驾驶感知模型的训练,增强车载小模型的感知能力;而毫末智行DriveGPT则可以采用RLHF(人类反馈强化学习)技术,通过引入真实人驾接管数据,对自动驾驶认知决策模型进行持续优化。

至于前面提到的高延迟、难部署,说到底也只是个阶段性问题:只要算力足够大、延迟就可以降低,部署问题也会迎刃而解。

或许随着车载AI芯片的算力的持续“膨胀”,多模态大模型上车离我们并不遥远。