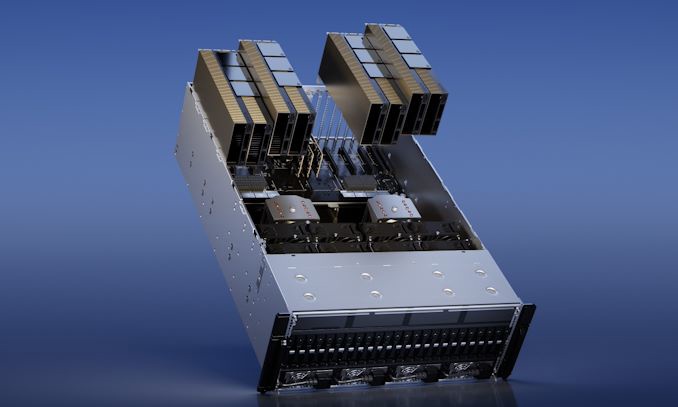

IT之家 3 月 22 日消息,在 GTC Spring 2023 主题演讲中,针对不断增长的 AI 市场,推出了全新的双 产品 H100 NVL。H100 NVL 在顶部配备了 3 个 NVLink 连接器,使用两个相邻的 PCIe 显卡插槽。

本文引用地址:

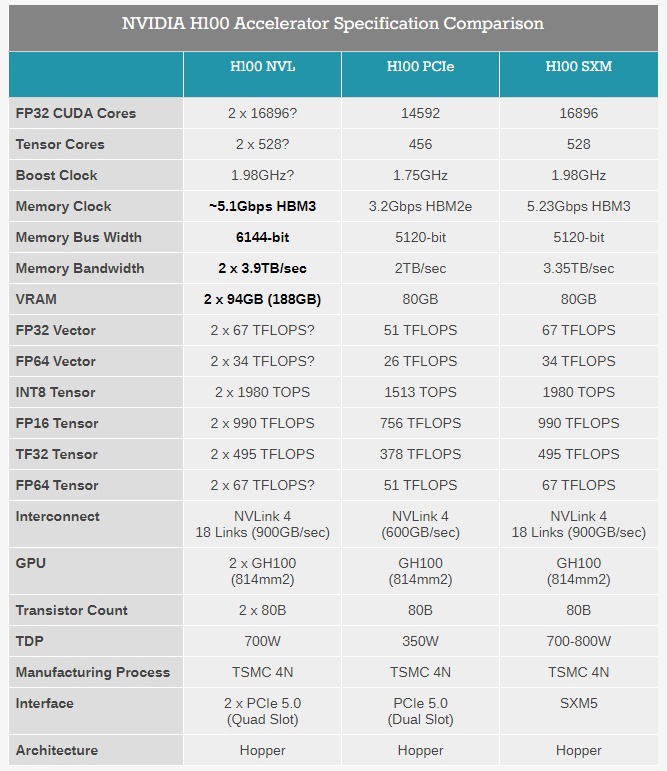

表示在运行大型语言模型(LLM)时,常规显卡的显存无法驾驭庞大的数据流。因此本次推出的 H100 NVL 最高可以提供 188GB HBM3 显存,单卡显存容量 94GB。

H100 NVL 的功耗略高于 H100 PCIe,每个 为 350-400 瓦(可配置),增加了 50W。IT之家从报道中获悉,总性能实际上是 H100 SXM 的两倍:FP64 为 134 teraflops,TF32 为 1979 teraflops,FP8 为 7916 teraflops,INT8 为 7916 teraops。

内存带宽也比 H100 PCIe 高很多,每个 为 3.9 TB / s,总和为 7.8 TB / s(H100 PCIe 为 2 TB / s,H100 SXM 为 3.35 TB / s)。