2021年10月至今,中科院计算所面向全行业先后发布了《专用数据处理器(DPU)技术白皮书》和《专用数据处理器(DPU)性能基准评测方法与实现》,两份白皮书较为全面地解释了,DPU为何被定义为数据中心发展的颠覆性技术。

在DPU性能基准评测白皮书里,阐述了DPU在网络、存储、计算和信息安全四个领域的评测和实现方法,这也是DPU释放潜能的四大领域,同时它们恰恰又是数据中心的关键环节。因此,DPU、CPU、GPU被称为算力经济时代的三驾马车,DPU成为数据中心领域“第三颗主力芯片”。此外,智能驾驶、数据通信、网络安全等也是DPU的目标应用领域。根据赛迪网的估算,从2023年开始全球DPU市场规模将突破百亿美元,后续年增长率超50%。

图源:赛迪网

这就是为什么英伟达CEO黄仁勋在发布该公司首款DPU产品时要着重强调,“这只是一个开始。”目前,不仅英伟达等产业巨头在紧盯DPU赛道,井芯微电子等初创公司也脱颖而出,展现出非凡的技术实力,产品获得行业认可。

DPU是什么?

要想知道DPU为什么热,那么首先就要搞清楚,DPU到底是什么?

DPU的英文全称为Data Processing Unit,直译过来就是数据处理单元,也被一些从业者称为数据中心处理器。 DPU以数据为中心,核心作用是做数据加速处理,帮助系统解决CPU处理效率低,GPU又无法处理的负载。

根据DPU技术白皮书,DPU处理的数据和传统DSP、基带处理器等处理器处理的“信号”,以及GPU处理的图形图像类数据不同,DPU处理的数据是更加靠近底层架构、数字化的各种信息,特别是各种时序化、结构化的数据,比如大型的结构化表格,网络流中的数据包,海量的文本等等。

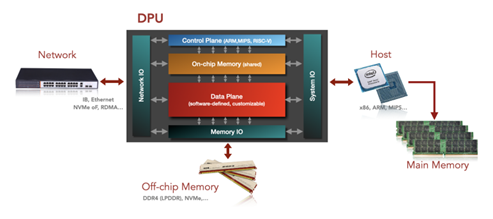

DPU架构参考设计

图源:DPU技术白皮书

DPU潜力巨大

不难发现,DPU是以解决数据中心发展瓶颈为第一出发点而提出的,是数据中心用服务器走向异构计算的最大受益者。随着数据中心市场的蓬勃发展,DPU在该领域的潜力巨大。

以中国市场为例,数据中心第一波浪潮于2014年-2015年拉开帷幕,主要服务于当时快速发展的互联网,当时国内出现了很多数据交易所。从具体特征来看,数据中心第一波浪潮是以计算为核心,然而很快以CPU为主要算力平台的方式便出现了瓶颈,且CPU在资源管理方面普遍存在20%-30%的算力资源浪费,这就带来了算力提升的无力感。

数据中心第二波浪潮开始于2020年,也就是人们所说的“DPU元年”,其中最明显的变化是数据中心不再强调计算中心和算力中心的概念,而是回归以数据为中心的本质。在这个过程中,云和应用算法的种类都愈发丰富多样,提升数据处理效率当然还是主要目标,不过给CPU减负以增强系统调度能力也是一个大方向。

从“以计算为中心”到“以数据为中心”是巨大的观念转变,DPU得以从众多协处理器中脱颖而出。作为数据处理的专用引擎,未来不断丰富的DPU产品类型将使得CPU回归自己擅长的领域——统筹全局和任务调度,释放CPU的算力到上层应用,DPU将化身为新的系统网关、存储入口、算法加速沙盒以及安全引擎。

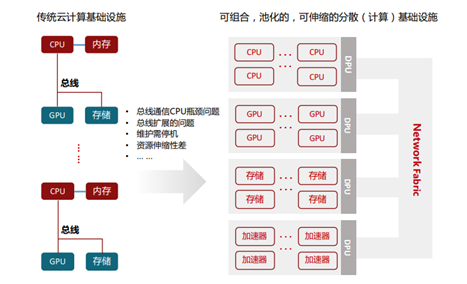

从下图能够看出,在以数据为中心的数据中心框架下,DPU可谓是无处不在。

传统云计算基础设施与以数据为中⼼的数据中⼼架构对⽐

图源:DPU技术白皮书

当然,DPU想要在数据中心领域兑现潜能也需要克服一些挑战。首先,在硬件层面DPU的产品种类需要足够丰富,如上所述,需要在网络、存储、计算和信息安全四大维度对CPU进行全面卸载,同时不同厂商的DPU产品需要遵循通用的标准,并在整体方案上体现总拥有成本优势;在软件层面,当前CPU和GPU在数据中心的应用均具有标准的软件框架,实现了软硬件解耦,DPU加入后,这也是一个长期且具有挑战的工作。

上述内容已经提到,DPU的终端应用场景绝不仅仅是在数据中心,在智能驾驶、数据通信、网络安全等领域,DPU也有广阔的应用前景。

比如在通信领域,基于DPU实现的⽹络功能虚拟化可应用于5G 边缘计算UPF,提升5G通信在垂直行业的高速和大带宽能力;在网络安全领域,DPU可助力打造硬件信任根,并能够以完全卸载的方式实现隔离⽹络虚拟化,与主机操作系统相隔离,使用户免受黑客攻击;在自动驾驶领域,DPU提供的各种虚拟化功能,可以更好地帮助开发者实现“软件定义汽车”。

国产DPU助力中国“新基建”

DPU已经打开了一个大的产业化趋势,我国“新基建”战略中的各领域将率先受益,加速数字化转型。同时,“新基建”和“东数西算”也将在数据和算力层面带来强劲需求,再加上国家在5G和自动驾驶等产业的宏大布局,国产DPU未来发展前景明朗。

紧抓DPU产业的中国芯机遇,井芯微电子技术(天津)有限公司(以下简称:井芯微)虽然还是一家年轻的初创企业,但是在DPU技术研发和产品商用进度方面,已经达到了国内领先水平。

井芯微于2020年在天津经开区成立,专注在新计算、新网络、新安全等创新赛道,为党政军、金融、能源、交通、电力、电信等重点行业的目标客户带来领先的DPU产品和技术服务。

根据DPU技术白皮书,DPU架构有三大核心组成部分,分别是控制平面、IO子系统和数据平面。在IO子系统方面,井芯微提供RapidIO嵌入式系统互连以及软件定义互连交换等原创性技术,已成功研发出RapidIO交换芯片NRS1800、软件定义互连交换芯片SDI3210、内生安全交换芯片ESW5610、桥接芯片PRB0400等系统IO产品。

在数据平面,井芯微已经发布一款集成AI引擎的网络处理智能芯片——井芯2820,主要面向云计算和数据中心网络应用及相关的任务卸载,并提供智能化的网络监控和管理能力。网络数据包的处理是DPU第一个发力场景,以“网络+算力”的模式为CPU 卸载,因此DPU也常常被视为 SmartNIC (智能网卡)的升级版,但我们都知道DPU的潜力绝不止于此。

井芯2820实现了2-7层的报文解析和应对云计算、工业互联网等关键应用的加速能力。同时,该芯片具备可升级扩展能力,能够应对变化迅速的大数据处理、时延敏感应用要求,并具备快速部署能力。

井芯2820支持三大应用场景:

标准网卡模式该模式下,芯片工作在标准的网卡方式,可以配置成2*100GE标准网卡、4*10GE网卡、2*25GE或者2*10GE网卡,支持最大16*PCIE4.0,支持多虚拟机的SR-IOV数据传输。软件通过标准的linux网卡驱动访问网络接口卡。

智能网卡模式该模式下,CPU和AI引擎参与数据处理,芯片工作在智能卸载模式。数据报文经过两个路径发送,一个是控制路径,相关的协议报文,控制报文转发至CPU核,用于各种协议控制面例如RDMA,OVS等的处理;一个是数据路径,用于处理报文的封装/解封装,数据处理加速等。AI引擎实时提取和分析输入数据,检测和识别数据流量是否有恶意攻击行为,进行上报和告警。

独立主控模式该模式下,井芯微网络处理智能芯片可以独立工作,成为一颗具备AI引擎的网络主控CPU芯片。PCIE工作在RC模式下,可外接各种外设,例如24口/48口千兆交换芯片、SRIO交换芯片等。CPU运行独立的linux操作系统和网络协议栈,实现交换机的主控功能。

这颗双100G网络处理智能芯片的推出,代表了本土企业在DPU领域的开拓迈出了关键一步。后续,井芯微将持续关注软件定义互连、内生安全和类脑计算三大战略方向,推动DPU等产品的快速迭代,为国家“新基建”战略推进贡献创新力量。