第一个提出自动驾驶并进行研发的公司是Google,巧的是,它发布的Transformer模型也为今天的大模型发展奠定了基础。

自动驾驶已经完成从概念到现实的华丽转变,彻底重塑了传统驾车方式,而大模型行业正在经历的,恰如自动驾驶技术发展的传奇征程——

最顶尖的研发团队竞相投身其中、不断加速抢跑的技术产品创新,以及持续被推向极致的用户体验。

在大模型赛道中,有一家企业始终以领先的身位,推动着行业边界向前拓展。

为什么是联汇科技?

当行业刚开始关注大模型,他们已经锚定多模态大模型,并高分取得了工信部大模型检测的001号证书;

去年,当人们关注“百模大战”,他们不仅发布了自研OmModel多模态大模型的V3版本,更发布了国内首批大模型驱动的自主智能体应用;

今年,世界人工智能大会期间,他们再次发布一系列技术成果,将大模型技术产品推向更深、更广的应用层面。

联汇科技技术团队有着极强的前瞻思维,这与他们的首席科学家赵天成博士紧密相关,这位师从国际AI领域顶尖学者的Maxine Eskenazi,在CMU LTI (卡内基梅隆大学语言技术研究所)完成硕博连读的天才少年,不仅称得上「AI 名门正派」,更难得的是,赵天成在技术发展和战略规划方面有着独到见解。

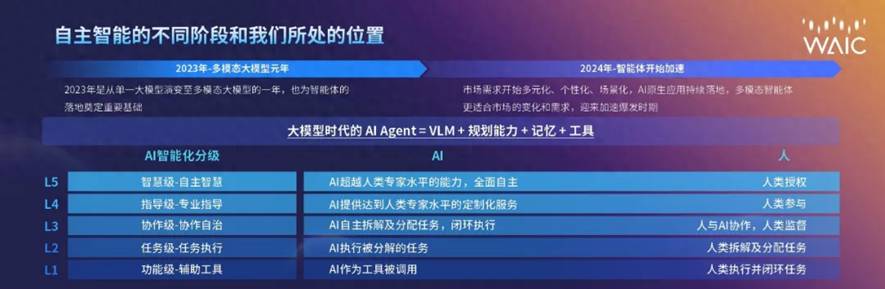

赵天成博士指出,在AI主导的第四次工业革命浪潮中,自主智能将成为变革的核心变量。随着人类第一次接触并掌握创造智慧的奥秘,我们将目睹一个新时代的到来——在这个时代中,机器、软件甚至系统,将被赋予前所未有的自主决策能力,自动化将广泛应用于各个工作领域,开启前所未有的效率和创新。

2024年是智能体元年。

我们正处于L2级别,并逐步向L3、L4迈进的过程中。

OmAgent来了!

WAIC期间,联汇科技正式发布第二代多模态智能体 OmAgent。

去年同期,联汇科技抢跑行业,率先发布了国内第一批由多模态大模型驱动的自主智能体,那么,今年联汇的第二代多模态智能体OmAgent有哪些惊喜?

首先是感知模块全新升级。

随着AI应用落地,联汇科技发现尽管万物感知模型在智能识别和处理方面具有巨大潜力,但受限于推理速度的瓶颈。相较于小型模型在推理速度上的优势,Idealab的G-DINO和联汇科技的OmDet在速度上的表现都不尽如人意,这极大地限制了它们在边缘计算设备上的应用。

联汇科技最新发布的OmDet V2,实现万物感知的全面加速,从底层重新构建了万物感知的模块,推出了EFH高性能融合头,包含了一系列模型加速的优化技术、语言向量缓存、轻量化特征编码与解码等技术,得益于EFH对每一个环节的机制优化,相较于G-DINO和联汇的第一代感知模型,OmDet V2在每一个环节上都实现了20倍以上的速度提高。

这样的提升意味着OmDet V2正在打开未来边缘AI与具身智能全新可能。

凭借OmDet V2的推理速度和精确分析能力,单个GPU就可以承载对500路视频流的实时万物感知分析,这是对技术性能的新一次刷新。同时,这也意味着打开边缘AI的可能,OmDet V2让万物感知模型摆脱云端束缚,走向边缘设备,为人形机器人、家庭智算中心等前沿应用提供了强大的智能支持。

这种创新不仅重新定义了大模型产品的开发思维,更为构建一个更实时、更安全、更注重隐私的大模型应用环境奠定了基础。

第二是思考决策能力的提升。

思考是多模态智能体的核心,只有具备了思考能力,智能体才能够依据感知和记忆结果做决策判断和自主行为,成为真正的助手。但现有多模态思考模型存在着明显局限,比如只能基于单张图片进行思考和决策、无法对多个关联图片之间进行理解处理等。

为了解决这一问题,联汇科技全新发布了第二代思考大模型OmChat V2,一个基于多模态模型原生预训练的生成大模型,不仅提供8B、40B、60B多个版本,适配不同需求。更能非常好地支持视频、图文混合、文字等多种复杂输入,完美适配智能体决策过程中所需要的复杂场景。

OmChat V2支持高达512K、50万的上下文长度,折合视频长度30分钟,仅次于Google Gemin-1.5,并远超GPT-4o及微软LLaVa-1.5。

OmChat V2在Mantis-Eval、Q-Bench、MileBench Real、MVBench等测试中平均性能均在行业前列。

更简单、直接的说法是,OmChat V2不仅能够看准时序关系,更能够看懂多图关系。

△时序关系判断

△多图关系理解

为了大模型与智能体技术能够真正的普惠落地,联汇科技还率先完成了与多款国产GPU的适配与性能验证,通过高效稀疏激活、动态专家方法,提升推理效率20倍,OmOS大模型运行平台也是首个支持多地域大模型分布式推理平台,异构九头蛇推理能够提升算力利用率3倍。

就此,联汇科技正式解锁海量行业应用场景。

△自动化体育解说

△影视剧内容解构

△工业智能助手

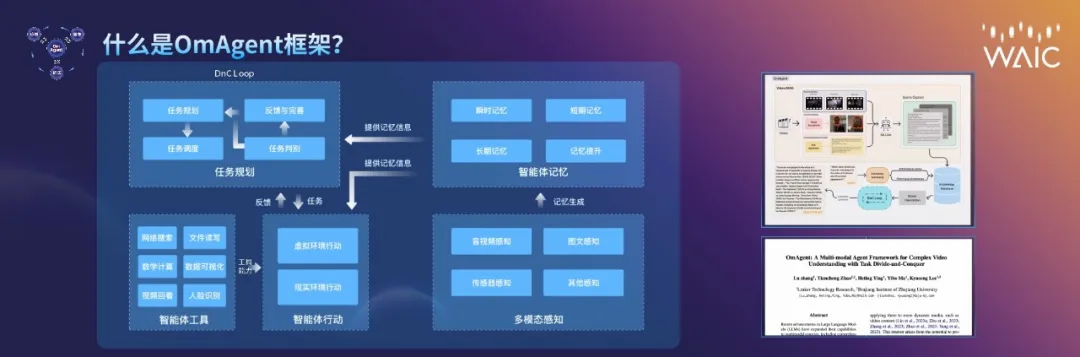

OmAgent框架全面开源!

联汇科技在多模态智能体技术上已经取得了多项突破性成果,对于是否开源的问题,赵天成博士始终从更宏观、更长远的角度看待。

他表示:我们选择将OmAgent框架全面开源,是因为想要鼓励更多企业、开发者参与,通过知识共享和技术创新构建一个更加开放、更加丰富的智能体生态,进而能够带动整个行业更好的发展。

OmAgent框架不仅包含了感知、记忆、决策等综合模块,并整合融入OmDet、OmChat等多个不同类型的大模型能力,极大方便企业与开发者的应用开发,推动智能体技术向更深层次、更广领域的赋能。

通过OmAgent,能够快速、准确解决各类场景下的复杂问题。比如,从影视剧中总找出某个问题的答案,尽管影片没有直接呈现答案,但是OmAgent依然可以通过对全片的整体理解,掌握剧情并根据原片内容进行思考、作答。

Step 01

Step 02

Step 03

Step 04

目前,OmAgent框架已全面开源。

在WAIC,联汇科技对OmAgent做了完整的现场互动演示。

为了让智能体更快地融入日常工作与生活,联汇正式发布了Om多模态智能体全新产品系列——空间运营智能体、知识服务智能体,为行业用户打造“超级助手”。

空间运营智能体是通过摄像头、拾音器等物联设备以及接入的各类数据源对空间物理环境全面感知,深度融入大模型的思考能力,准确处理、分析多模态数据信息,洞察运营中的关键问题、潜在机会,基于智能体角色设定的目标任务,结合记忆和学习,实现面向物理空间的思考、规划与决策,成为用户进行空间管理的得力助手。

应用范围覆盖线下零售、营业厅、机房、产业园区、文旅景区、城市街区等各类单体空间、连锁环境,实现对空间的精细化运营与管理。

相较于空间运营智能体对现实物理世界的运营管理,知识服务智能体更强调对数字世界的管理和对数字资产的价值挖掘。

它可以作为专为行业定制的人工智能助手,广泛应用于办公、生产、运维、营销、培训、客服等场景,将企业、组织和个人在特定领域内积累的经验、技术、业务流程等转化为结构化的行业专用知识,通过知识管理、知识检索、知识问答与知识生成等核心能力,提升用户决策质量、优化操作流程,最终将无形的知识资产转化为有形的生产力。

2024无疑将是智能体元年,智能体也正在成为大模型落地的最佳途径。

关于未来,赵天成博士透露了他的预判——

智能体的未来不是单打独斗,而是大模型的组合拳,尤其是当多种类大模型协同作战时,它们能释放出远超单一大语言模型的潜力。

智能体将打破传统聊天机器人的界限,它们的应用形态将经历一场革新,变得更加多样化和深入人类活动的各个方面。

随着边缘AI的兴起,大模型将不再局限于大型服务器,它们将走向边缘,被嵌入到众多小型设备中,实现真正的无处不在。

技术咨询

技术咨询 代买器件

代买器件 商务客服

商务客服 研发客服

研发客服