下一代版本的GH200 Grace Hopper超级芯片将成为世界上第一个配备HBM3e内存的芯片。HBM3e内存将使下一代GH200运行AI模型的速度比当前模型快3.5倍。

本文引用地址:·最新版本的GH200超级芯片将于2024年第二季度推出。这个时间晚于AMD推出的最新数据中心(Instinct MI300X)的上市时间。

首席执行官黄仁勋穿着他标志性的皮夹克登上了世界顶级计算机图形学会议SIGGRAPH的舞台。

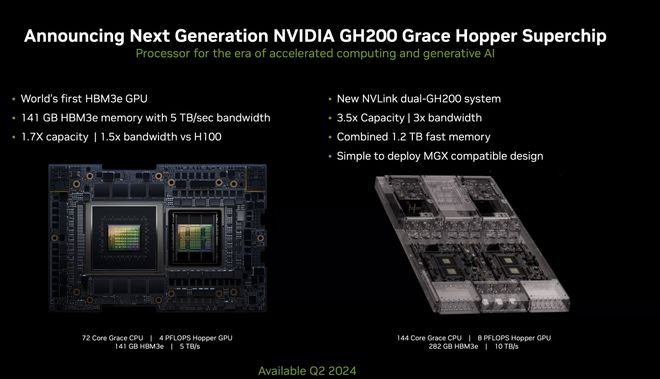

太平洋时间8月8日,首席执行官黄仁勋穿着他标志性的皮夹克登上了世界顶级计算机图形学会议SIGGRAPH的舞台,宣布推出下一代版本的GH200 Grace Hopper超级芯片,该芯片将成为世界上第一个配备HBM3e(High Bandwidth Memory 3e)内存的芯片。与当前一代产品相比,最新版本的GH200超级芯片内存容量增加了3.5倍,带宽增加了3倍;相比最热门的H100芯片,其内存增加1.7倍,传输频宽增加1.5倍。

下一代版本的GH200 Grace Hopper超级芯片将成为世界上第一个配备HBM3e内存的GPU芯片。

GH200超级芯片本身并不是一个新产品,而是今年5月在中国台北Computex展上发布的GH200芯片的更新版。有趣的是,另一家芯片巨头AMD在6月推出搭载了192GB HBM3内存的数据中心GPU(Instinct MI300X)时,就有业界人士提出其可能难以形成优势,因为可能会在同一时间段甚至更早时间内提供相同的内存。

英伟达超大规模和高性能计算副总裁兼总经理伊恩·巴克(Ian Buck)对澎湃科技(www.thepaper.cn)表示:“我们对这款新的GH200感到非常兴奋。HBM3e不仅增加了GPU的容量和内存量,而且速度也更快。”

英伟达表示,HBM3e内存将使下一代GH200运行AI模型的速度比当前模型快3.5倍。不过一个关键的问题是,英伟达没有透露超级芯片GH200的价格,这对计算成本高昂的大模型来说尤为重要,H100系列目前售价约为4万美元。

值得注意的是,这次发布并未抬升英伟达的股价。其股价在发布会前已下跌约1%,消息公布后跌幅达3%,至盘中低点440.56美元,最终下跌1.66%至446.64美元。不过,AMD股价也在当天收盘下跌3.1%,至113.23 美元。与此同时,以科技股为主的纳斯达克综合指数下跌0.8%。

太平洋时间8月7日,摩根士丹利分析师爱德华·史丹利(Edward Stanley)发布报告称,“无论是以英伟达为首的AI个股还是狭义AI类股,自年初以来涨幅都超过200%。但一般而言股市泡沫在达到顶点前的3年回报率中间值约在150%,由此可见近来这波AI概念股涨势已经过头。”

为什么内存对大模型重要?

随着支撑生成式人工智能应用程序的基础AI模型尺寸的增加,为了能够在不连接独立芯片和系统的情况下运行,大模型需要更大的内存量,以避免性能下降。

巴克对记者表示,新款GH200的内存“快得多”,“拥有更大的内存允许模型保留在单个GPU上,并且不需要多个系统或多个GPU来运行。”“额外的内存只会提高 GPU的性能。”目前即使使用英伟达最顶级的H100芯片,有些模型也必须在其他GPU中“分解”模型才能运行。

据英伟达介绍,最新版本GH200配备141GB的HBM3e内存,旨在处理“世界上最复杂的生成式人工智能工作负载,涵盖大型语言模型、推荐系统和矢量数据库”。

“我们正在为Grace Hopper超级芯片提供全球最快的内存增强。”黄仁勋在主题演讲中说,“这款处理器旨在为全球数据中心的规模扩展而设计。”

据巴克对澎湃科技在内的媒体透露,最新版本的GH200超级芯片将于2024年第二季度推出。这个时间晚于AMD推出的最新数据中心GPU(Instinct MI300X)的上市时间,后者将搭载类似的5.2 TB/s带宽,192GB HBM3内存。据悉,MI300X将在第三季度出样,相关产品预计第四季度上市。

HBM3e和HBM3是什么关系?

HBM(高带宽内存)各代之间的区别主要在于速度。据TrendForce报告,市场上的HBM3根据速度细分为两类:一类包括运行速度在5.6至6.4Gbps之间的HBM3,而另一类则采用8 Gbps的HBM3e。

HBM3e内存比当前一代GH200中的HBM3技术快50%,将GPU的数据传输速率从原始Grace Hopper的4TB提高到每秒5TB(万亿字节)。

英伟达尚未宣布他们将从哪里采购用于其GH200 GPU的全新HBM3e内存芯片。但此前据韩国《Money Today》和《首尔经济日报》援引业内人士的消息称,英伟达已向芯片制造商海力士(SK Hynix)索要HBM3e样品,以评估其对GPU性能的影响。

英伟达计划销售两种版本:一种版本包含两个可供客户集成到系统中的芯片,另一种版本是结合了两种Grace Hopper设计的完整服务器系统。

巴克对记者表示,英伟达正在开发一种新的基于双GH200的英伟达MGX服务器系统,该系统将集成两个下一代Grace Hopper超级芯片。他解释说,新的GH200将以英伟达的互连技术NVLink连接。

所谓超级芯片即是将英伟达的Grace中央处理单元(CPU)和Hopper图形处理单元(GPU)连接在一起,以便它们能够更有效地协同工作。借助新型双GH200服务器中的NVLink,系统中的CPU和GPU将通过完全一致的内存互连进行连接,每个超级芯片可以以相同的方式与其他芯片连接在一起,从而使它们可以像单个单位一样运作。

巴克表示,“CPU可以访问其他CPU的内存,GPU可以访问其他GPU的内存,当然GPU也可以访问CPU的内存。因此,合并的超大型超级GPU可以作为一个整体运行,提供了144个Grace CPU核心,超过8 petaFLOP(每秒钟进行1千万亿次浮点运算)的计算性能以及282GB的HBM3e内存。”

有趣的是,尽管名称为“GH200”,英伟达并没有谈论GPU芯片本身的任何变化。从历史上看,英伟达的型号数字明确表示产品和架构的变化,第一个数字位置中的“2”表示全面的架构修订,例如支撑了GeForce 900系列的“Maxwell 2”架构,所有这些部件的代号都是“GM2xx”。可能Hopper芯片本身在这个版本中已经经历了修订,但英伟达并没有谈论这方面的内容。

其他发布

除了GH200,英伟达的桌面AI工作站GPU系列也全面上新,一口气推出了4款新品:RTX 6000、RTX 5000、RTX 4500和RTX 4000。针对企业客户,英伟达还准备一套一站式解决方案—— RTX Workstation,支持最多4张RTX 6000 GPU。

针对数据中心市场,英伟达推出了最多可搭载8张L40S GPU的OVX服务器。据介绍,对于具有数十亿参数和多种模态的生成式AI工作负载,L40S相较于老前辈A100可实现高达1.2倍的推理性能提升,以及高达1.7倍的训练性能提升。

除了各种强大的硬件之外,英伟达还发布了全新的AI Workbench,来帮助开发和部署生成式AI模型。AI Workbench为开发者提供了一个统一且易于使用的工具包,能够快速在PC或工作站上创建、测试和微调模型,并扩展到几乎任何数据中心、公有云或英伟达的云服务DGX Cloud上。

作为最受AI开发者喜爱的平台之一,拥有200万用户、超25万个模型,以及5万个数据集的Hugging Face也与英伟达达成合作。开发者可以通过Hugging Face平台直接获得英伟达DGX Cloud AI超算的加持,完成AI模型的训练和微调。

此外,英伟达的元宇宙开发平台Omniverse也进行了更新。在接入了OpenUSD和AIGC工具之后,开发者可以更加轻松地生成模拟真实世界的3D场景和图形。

OpenUSD是皮克斯动画工作室开发的一种开放数据格式,允许团队能够在大规模3D工作流程上协同工作,并共享可在AR(增强现实)和VR(虚拟现实)项目中使用的3D对象和环境的信息。当地时间8月1日,美国3D内容行业的5家主要公司苹果、英伟达、皮克斯、Adobe和Autodesk联合成立了OpenUSD联盟(AOUSD)。OpenUSD技术是Omniverse平台的基础,有一天可能成为“元宇宙”的3D图形标准。

相关文章

技术咨询

技术咨询 代买器件

代买器件 商务客服

商务客服 研发客服

研发客服